美媒:中国生物技术的惊人进步正在改变世界药物研发线

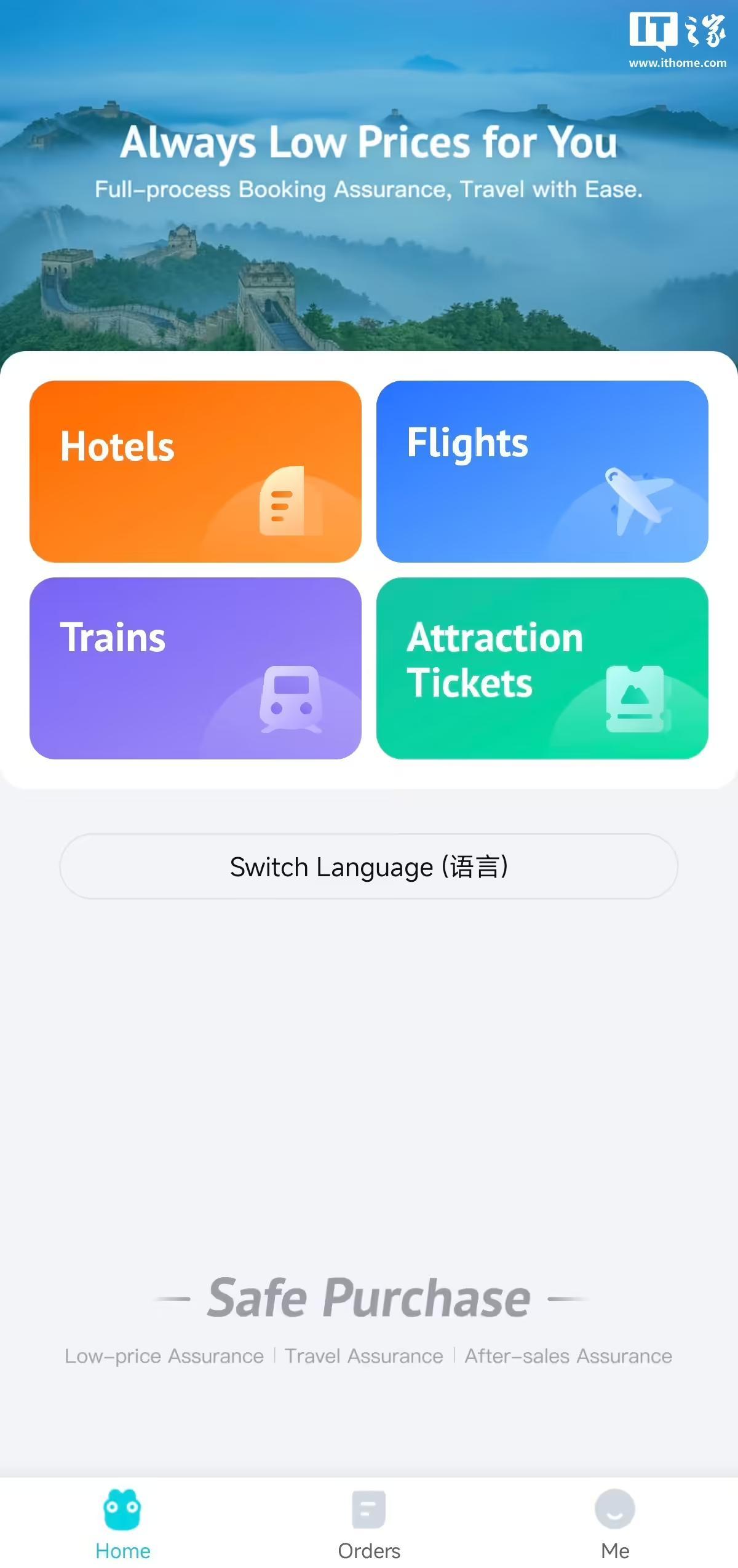

6 月 9 日,中国南京的 CAR-T 细胞疗法生产实验室。世界上最严格的监管机构越来越多地认为中国药物总体上具有足够的前景,值得投入额外的资源来加快审查。摄影师:沈其来/彭博社

中国生物技术的惊人进步正在改变世界药物研发线

中国生物技术的进步与中国在人工智能和电动汽车领域的突破一样迅猛,超越了欧盟,赶上了美国

作者:Amber Tong、Jinshan Hong、Spe Chen

2025年7月14日上午5:00(格林威治标准时间+8)

彭博新闻独家分析显示,去年中国进入研发阶段的抗癌、减肥等新药数量激增至 1,250 多种,远远超过欧盟,几乎赶上美国的约 1,440 种。

而来自曾经因廉价仿冒品和质量问题而臭名昭著的中国的候选药物正日益突破高门槛,赢得药品监管机构和西方制药巨头的认可。

这项研究结果来自对制药情报解决方案提供商Norstella维护的数据库的分析,表明医疗创新的重心正在发生根本性转变。鉴于唐纳德·特朗普总统已威胁对制药行业征收关税,中国生物技术的进步——其规模正逐渐显现——有可能成为与人工智能和电动汽车类似的超级大国竞争的另一个领域。

“这种规模是我们以前从未见过的,”艾意凯咨询驻上海的管理合伙人陈海伦表示,她自 2003 年以来一直为医疗保健公司的中国战略提供咨询服务。“我们的产品已经上市,它们很有吸引力,而且发展速度很快。”

这种转变以前所未有的速度发生。2015年,中国开始全面改革药品监管体系时,全球创新药物研发管线中仅有160种化合物,占总量的不到6%,落后于日本和英国。这些改革有助于简化审查流程,强化数据质量标准,并提高透明度。政府提出的“中国制造2025”计划旨在提升十大重点领域的制造业,这也刺激了生物技术领域的投资热潮。总而言之,这些改革引发了由海外教育和培训的科学家和企业家引领的生物技术产业繁荣。

Norstella 思想领导力副总裁丹尼尔·钱塞勒表示:“中国不仅现在几乎与美国持平,而且还保持着这样的增长轨迹。如果仅从新药上市数量来看,就断言中国将在未来几年超越美国,这并不耸人听闻。”

除了数字之外,更令人瞩目的是中国生物技术创新质量的飞跃。尽管制药行业一直在争论中国企业是否有能力生产出不仅有效而且具有颠覆性意义的新疗法,但各方在多个方面对此的认可度正在不断提高。包括美国食品药品监督管理局和欧洲药品管理局在内的全球最严格的监管机构越来越多地认为,中国药品总体上前景广阔,值得投入额外资源来加快其审查速度,并授予其令人垂涎的行业称号,例如优先审查、突破性疗法认定或快速通道资格。

数据显示,截至 2024 年,该国在获得此类快速审查方面略微领先于欧盟,与之前生产 Wegovy 等药物的地区相比,具有显著优势。

IASO生物治疗中心的CAR-T细胞疗法生产实验室

中国创新的早期典范之一是一种细胞疗法,它有望治愈一种致命的血癌。摄影:沈其来/彭博社

中国创新的早期典范之一是一种细胞疗法,它已显示出治愈致命血癌的潜力。该疗法最初由中国传奇生物科技公司开发,目前由强生公司销售,并在此过程中获得了一些快速审查资格,被认为优于一种源自美国的竞争疗法。

尽管如此,获得这些称号的中国原产药品的绝对数量仍远远落后于美国药品。

规避风险仍然是阻碍中国医药创新的一个因素:到目前为止,顶尖公司往往专注于改进现有疗法或对旧理念进行新的迭代,很少有公司开拓从未尝试过的新型治疗方法——这种尝试具有很高的失败风险,并且仍然由美国、欧洲以及程度较轻的日本引领。

尽管如此,中国最大的突破正日益被制药巨头以创纪录的价格抢购,这表明下一个重磅药物的长期竞争也正在向东方转移。

康方生物股份有限公司(Akeso Inc.)研发的一款新型抗癌药物,去年在中国的一项研究中被证明比默克公司(Merck & Co. )的Keytruda更有效,被比作中国生物科技公司的“深寻时刻”,引发了全球新一轮的关注。超越全球最畅销药物Keytruda的前景也推高了Summit Therapeutics Inc.的估值,该公司于2022年预付5亿美元,获得了该药物在美国和其他地区的开发和营销权。

默克、阿斯利康和罗氏控股等其他跨国公司也纷纷收购中国资产。今年5月,辉瑞公司宣布与三生制药达成一项12亿美元的预付款协议,以开发一种与康方生物类似的抗癌药物,创下新纪录。生物制药交易数据库DealForma的数据显示,这类交易的价值和频率都在增加,这表明人们相信中国本土药物在国际上具有竞争力,并能带来可观的收入。

诺斯特拉的校长表示,来自中国的潜在候选人数量意味着跨国公司可以“比以往更加广泛地撒网”,因为跨国公司需要不断增加新产品。

推动中国生物科技公司崛起的一个关键优势是,它们能够以更低的成本、更快速地开展从实验室实验、动物测试到人体试验的每个研究步骤。

众所周知,从零开始研发一种新药耗时耗力,成本高昂,而中国庞大的患者群体和集中式医院网络成为重要的加速器。对药物各阶段测试所需时间的分析表明,中国医生可以更快地招募试验对象——对于癌症和肥胖症药物的早期试验,他们完成患者入组的时间是美国的一半。

成本差异意味着中国公司可以同时进行多个试验以找出成功者,或者在一个科学想法得到其他团体的验证后迅速启动新项目。

根据GlobalData 的数据,自 2021 年以来,中国已成为全球临床研究的首要地点,启动了全球最多的新试验。

“他们可以超越其他国家的竞争对手,”帮助公司开展临床试验的 Novotech Health Holdings 中国区负责人Andy Liu表示。

诚然,在中国获得临床数据只是一个开始。美国监管机构已明确表示,仅在中国进行的试验结果,无论多么积极,都不足以支持药品审批。有意向在海外销售药品的中国生物科技公司必须通过复杂且进展缓慢的全球研究,证明其治疗效果可以在中国以外的患者身上复制。

大量来自中国的药物可能还需要几年时间才能获得美国和欧盟的批准——高质量治疗的黄金标准——并在西方世界广泛使用,但许多业内人士认为这是不可避免的。

中国的创新者既包括由受过海外教育的企业家创办的尖端生物技术初创公司,也包括像江苏恒瑞医药股份有限公司这样的老牌中国制药公司,后者曾是中国最大的仿制药制造商之一。

在中国政府降低仿制药价格的举措导致该领域利润下降后,该公司投入了数十亿美元转向创新研发。目前,就2020年至2024年期间新增创新药物研发数量而言,该公司已成为全球排名第一的制药公司。

连云港恒瑞生物医药产业园。摄影:王建民/ostfoto/Future Publishing via Getty Images

2020年至2024年间,产生创新药物候选数量最多的50家公司中,有20家是中国公司,而之前五年只有5家。

“随着我们不断前进,中国在生物技术领域拥有高质量创新的事实将不再是新鲜事,”伦敦医疗咨询公司Treehill Partners的创始人兼董事总经理阿里·帕沙扎德(Ali Pashazadeh)表示。“这将成为公认的常态。”

在中美两国地缘政治争端再起之际,中国生物科技生态系统的蓬勃发展正引起一些美国政界人士和商界领袖的担忧。美国国会的一个委员会警告称,美国有可能在另一个事关国家安全的关键行业中失去领导地位。

尽管世界两大经济体之间新近出现的对抗关系存在风险,但康方生物等中国制药商已着眼于将其疗法推向西方发达市场。

“制药行业是世界上最好的行业,”康方生物首席执行官夏在4月份的一次采访中表示。“归根结底,我们所做的一切都是为了中国、美国乃至全世界的患者。”

本文出处:https://www.bloomberg.com/news/features/2025-07-13/china-drugmakers-catching-up-to-us-big-pharma-with-new-medicine-innovation